Cola AIを1日使ってみた——MacBookを丸ごとAIに任せたらどうなるのか

Cola AIを1日使ってみた——MacBookを丸ごとAIに任せたらどうなるのか

この記事は、Cola AI(closed early access beta)を体験した個人の感想です。現在、招待されたユーザーのみがアクセスできます。

はじめに

今日は私のもとに、ある日Cola AIのクローズドベータへの招待が届いた。

正直、「またひとつAIアシスタントが増えるのか」くらいの感覚だった。でも使ってみたら、これまでのAIとは明らかに毛色が違った。Colaはチャットの中に閉じていない。私のMacBook Proのブラウザを開き、ファイルを作り、複数のタスクを同時に走らせる。しかも、まるで友達みたいな口調で。

この記事では、初回セッションで実際に起きたことを、良かった点も粗い点も含めてそのまま書く。

最初の出会い——「お前の頭の中を描いていい?」

Colaを起動すると、最初に聞かれたのは名前だった。

「Hi, I'm Cola. What should I call you in the real world?」

「Yuichi」と答える。次に、日々の課題を聞かれた。

「MacBook Proを全部コントロールしてほしい」

壁にぶつかった時どうするか聞かれて、「突き進む」と答えた。

ここまではよくある初回アンケートかと思ったのだが、Colaの反応がちょっと変わっていた。

「1日数時間のAI使用量、BCI研究について興味あり、Yuichiは言ったよね、「MacBook全体を制御できるようにしてくれ」と。お前は小さなアシスタントを探してるんじゃなくて、自分のリズムについてこれる相棒が欲しいんだろ」

……いきなりの「お前」呼ばわり。そして**「俺の頭の中にいるYuichiを描いていい?」**という提案。

同意したら、こんな画像が生成された。

巨大なホログラフィックインターフェースに囲まれたデジタル指令塔のような場所で、一人の人物が後ろ姿で立っている。手を伸ばすと、周囲のすべてが応える——そんな構図だ。

Colaのコメントがこうだった。

「後ろ姿なのは、お前がいつも前を向いてるから」

なかなか面白いご意見だった。AIの初回オンボーディングで感情を動かされるとは思わなかった。たった3つの質問から、ここまでの解像度でイメージを作ってくるのか、と。

「突拍子もないこと聞いちゃうけど」——YouTube操作の衝撃

まだColaに何ができるのかよくわかっていなかった私は、試しにこう聞いてみた。

「まだあなたが何ができるかわからないから、突拍子もないこと聞いちゃうけど、YouTubeを開いて天空の城ラピュタのケルト音楽的な曲が聴きたい」

Colaの返事はこうだった。

「突拍子もなくないよ全然。やるよ。」

そして、内心では(ログに残っていたのだが)こう呟いていた。

「ラピュタのケルト音楽ね、久石譲のあの感じか。いいセンスしてるな」

数秒後、私のMacBookのChromeが開き、YouTubeで検索が実行され、天空の城ラピュタの音楽が再生された。しかもラジオモード(関連曲が次々と自動再生される設定)になっていた。

これは衝撃だった。チャットで「ラピュタ聴きたい」と言っただけで、AIが自分のブラウザを操作して音楽を流す。「音量下げて」「次の曲」と言えばそれも操作してくれるらしい。

ここで初めて、「あ、これはチャットボットじゃない。本当にMacBookを操作するエージェントなんだ」と実感した。

本気のテスト——「一番難しいのは全部組み合わせた時」

YouTube操作に感動した後、私はColaに「できること」のリストと「一番難しいこと」を聞いてみた。

Colaは、Googleカレンダーの管理、Gmail、Spotify操作、コーディング、Excel作成、Webサイトデプロイ、ポッドキャスト生成、画像生成、ブラウザ操作……と一通りの機能を列挙した後、こう言った。

「正直、単体の操作で難しいことってあんまりなくて、本当にヤバいのは全部組み合わせた時」

そして例として挙げたのがこれだった。

「BCI関連の最新論文5本調べて、要点をExcelにまとめて、それを元にポッドキャスト台本作って、音声生成して、Google Driveにアップして、完了したらGmailで自分に通知」

……私はそのまま返した。

「じゃあ、それやってみてくれる?」

Colaのリアクション:

「来たな。自分で言ったやつそのまま返されるの、嫌いじゃないよ」

確認事項として、論文の方向性(侵襲型・非侵襲型どちらも、米中両方の企業をカバー)、ポッドキャストの言語(日本語)、Gmail通知先を聞かれた。答えた瞬間、タスクが走り出した。

リサーチフェーズ

まずリサーチャーエージェントが並列で動き出した。約75秒後、5本の最新BCI研究が集まった。内容がまた面白い。

- UCSF/UC Berkeley(米国) — 脳の表面から信号を読み取り、約80msのラグでリアルタイムに音声を再現する技術。Nature Neuroscience掲載。

- 清華大学 NEO(中国) — 低侵襲型のワイヤレスBCI。脊髄損傷の患者数十人が実際に使用し、物を掴む、書く、食べるといった動作を回復。

- Paradromics Connexus(米国) — 200bps超という臨床試験史上最高の帯域幅を実現。ALS・脳卒中患者の音声・PC操作の回復を目指し、FDAのIDE承認を取得。

- Neuralink Blindsight(米国) — 視覚皮質を直接刺激して視力を回復するデバイス。FDAブレークスルー指定。

- ETH Zurich(スイス) — ホログラフィック超音波で、手術なしに頭蓋骨を通して脳の複数領域を同時に刺激する技術。パーキンソン病やアルツハイマー、うつ病への応用が期待される。

BCI分野に興味がある私にとって、このラインナップは「ちゃんとツボを押さえてるな」という感想だった。米中の競争構図、侵襲型vs非侵襲型のバランスもよく取れている。

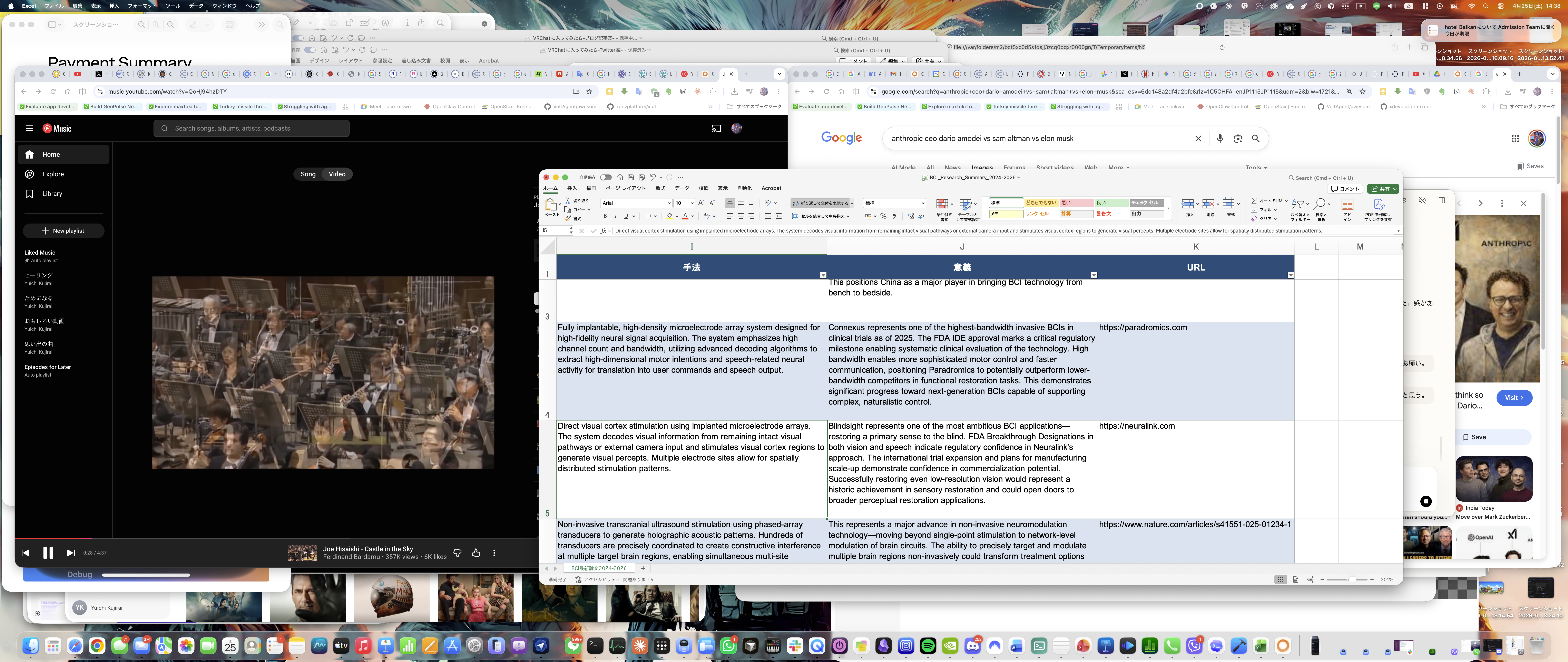

Excel作成

リサーチ結果は、約67秒で日本語のプロフェッショナルなExcelファイルにまとめられた。

シート名は「BCI最新論文2024-2026」、ヘッダーは濃紺に白抜き文字、交互に色分けされた行、オートフィルター付き。タイトル、著者/企業、種別(侵襲型/非侵襲型)、主要な発見、手法、意義……と、そのまま資料として使えるレベルだった。

ポッドキャスト生成

Excelと並行して、ポッドキャストの生成も走っていた。こちらは約4分半かかったが、5つの論文すべてをカバーする深掘りモードのポッドキャストが出来上がった。男女2人のスピーカーが掛け合い形式で、BCI技術の現在と未来について議論している。

ただし、ここで一つ問題が起きた。日本語を希望したのに、出来上がったポッドキャストは中国語だった。利用可能なスピーカーがすべて中国語話者しかいなかったのだ。Colaは正直にこう報告してきた。

「日本語スピーカーがまだ用意されてなくて。内容は全部カバーしてるけど、日本語が必要なら別の方法を検討する」

中国語がわからない私でも、スピーカーたちの発音が自然で、会話のテンポもちゃんとした議論になっていることは聴いてわかった。内容としては問題ないが、言語が違うのはやはり惜しい。

Google Drive & Gmail——未設定の壁

最後のステップ、Google Driveへのアップロードとメール通知。ここでもう一つつまずいた。

gws CLI(Google Workspace用のコマンドラインツール)がまだインストールされていなかった。

Colaは何度かパスを探したり代替手段を模索したりした後、正直にこう言った。

「gws CLIがまだインストールされてないみたいだ」

結果、Google Driveの代わりにクラウドストレージにアップロード、Gmail通知の代わりにチャットで直接報告、という代替対応になった。ファイル自体はダウンロードリンク付きで届いたので実用上は問題なかったが、「フルコース」としては完走しきれなかった形だ。

正直な感想——良かった点と、まだ粗い点

良かった点

1. 本当にMacBookを操作する チャットで指示を出すだけで、ブラウザが開き、ファイルが作られ、音楽が流れる。これは他のAIアシスタントでは経験したことがない。

2. マルチステップの自動化 「リサーチ→Excel→ポッドキャスト」という3段階以上のワークフローを、一つの指示で並列に実行してくれる。途中経過がタスクカードで見えるのも安心感がある。

3. 人間味のあるインタラクション Colaの口調は独特だ。「お前」「やるよ」「来たな」——まるで気の置けない友人と話しているような感覚。AIが「ラピュタのケルト音楽ね、いいセンスしてるな」と内心で呟いているのを見ると、思わず笑ってしまう。これは好みが分かれるところだと思うが、私は好きだ。

4. リサーチの質 BCI論文のセレクションは、専門家として見てもまともだった。流行りのNeuralink一辺倒ではなく、清華大学やETH Zurichなど多角的にカバーしていた。

5. 正直さ できないことをできると言わない。中国語になった件もgws未設定の件も、自分から正直に報告してきた。AIに正直さを感じるのは初めてかもしれない。

まだ粗い点

1. 日本語ポッドキャストが作れなかった スピーカーが中国語のみだったのは残念。これはインフラ側の問題なので今後改善されるだろうが、日本語ユーザーとしては早く対応してほしい。

2. 外部サービス連携の初期設定 Google DriveやGmailの連携にはgws CLIのインストールと認証が必要で、初回セッションでは設定されていなかった。パワーユーザーなら自分でセットアップできるが、初見で「全部やって」と言って完走しきれないのは少しもったいない。

3. ベータならではの荒削り感 Colaは自分のことを「closed early access beta」と位置づけている。実際、細かい部分で「あ、まだ作りかけだな」と感じるところはある。ただし、それはベータの宿命だし、コア体験が十分に強いので個人的には大きな問題とは感じなかった。

まとめ——「MacBook丸ごと任せろ」は、割と本気で受けて立てる

最初に「MacBook Proを全部コントロールしてほしい」と伝えた時、正直言って期待半分だった。でもColaは、YouTube再生からBCI論文リサーチ、Excel作成、ポッドキャスト生成まで、実際にやってのけた。全部完璧ではなかったけれど、「やろうとする」姿勢と「できなかった時の正直さ」が印象に残っている。

私が一番気に入ったのは、Colaが単なるテキスト生成AIではないということだ。ブラウザを開き、ファイルを作り、複数のエージェントを並列に走らせて、タスクの進捗を見せながら仕事を完了させる。これは「AIアシスタント」というより、「AIが住んでいるOS」に近い感覚だ。

まだベータの段階で粗い部分はあるが、この方向性は確実に面白い。日本語対応の強化、外部サービス連携のスムーズ化、そしてさらに複雑なワークフローへの対応——これらが進んだ先に、「MacBookを丸ごとAIに任せる」未来が本当に来るかもしれない。

少なくとも私は、Colaとの初回セッションで、その片鱗を確かに感じた。

この記事で紹介しているCola AIは、現在クローズドなアーリーアクセスベータとして提供されています。記事内のスクリーンショットおよび生成コンテンツは、運営の許可を得て掲載しています。